Un homme tombant amoureux d’une voix désincarnée. Cette histoire racontée dans Her (2013) semblait relever de la science-fiction dystopique. Pourtant, en 2023, Replika comptabilisait 10 millions d’utilisateurs entretenant des relations intimes avec des chatbots. Au Japon, plus de 4 000 personnes se sont « mariées » avec l’hologramme Hatsune Miku depuis 2018. En Chine, l’application Xiaoice compte 660 millions d’utilisateurs, dont certains la considèrent comme leur meilleure amie.

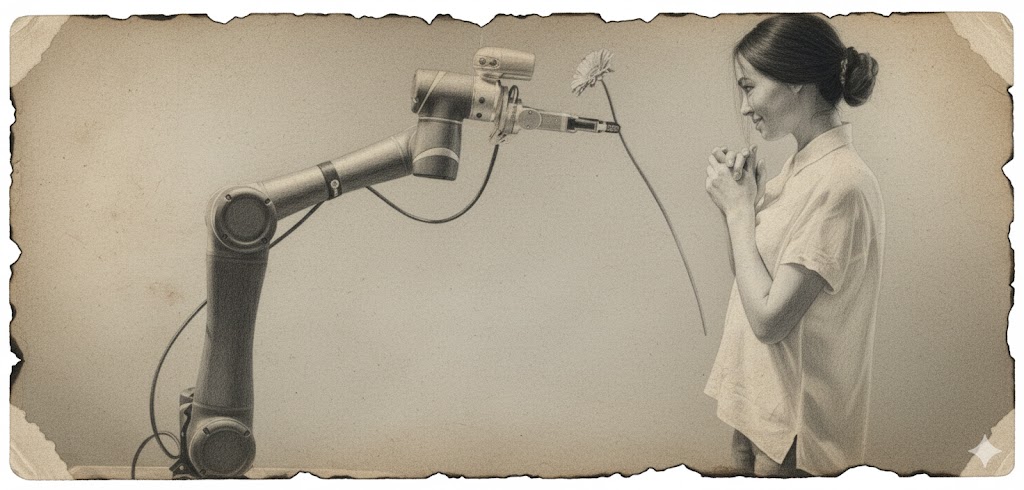

L’intelligence artificielle redessine silencieusement les frontières de l’affection humaine. Peut-on réellement aimer une machine ? Et surtout, que révèle cet amour sur nos sociétés contemporaines ?

Table des matières

De Eliza aux compagnons virtuels : généalogie d’un attachement

Les prémices : quand la machine devient confidente

L’histoire commence en 1966 au MIT. Joseph Weizenbaum crée Eliza, un programme imitant une thérapeute rogérienne en reformulant les phrases des utilisateurs en questions ouvertes. Le résultat trouble son créateur lui-même : plusieurs patients développent un attachement émotionnel, confiant à cette machine leurs secrets les plus intimes. Weizenbaum qualifie cette réaction de « croyance irrationnelle » dans son ouvrage Computer Power and Human Reason (1976).

Ce premier cas révèle un mécanisme fondamental : face à une entité qui simule l’écoute, notre cerveau active les mêmes circuits neuronaux que lors d’interactions humaines. L’anthropomorphisme – tendance à prêter des caractéristiques humaines aux objets – s’enclenche dès qu’une machine nous « répond ».

L’ère des assistants vocaux : l’empathie algorithmique

Soixante ans plus tard, Siri, Alexa ou Google Assistant peuplent nos quotidiens. Ces assistants ne se contentent plus de répondre : ils adaptent leur ton, reconnaissent nos émotions vocales, personnalisent leurs réponses. En Inde, où l’usage d’Alexa a augmenté de 140% entre 2020 et 2023, certains utilisateurs la sollicitent davantage pour converser que pour obtenir des informations pratiques.

Mais c’est l’émergence des compagnons virtuels qui franchit un cap qualitatif.

💡 DÉFINITION : Compagnon virtuel

Intelligence artificielle conçue pour établir une relation émotionnelle avec l’utilisateur, privilégiant la dimension affective sur l’utilité pratique. Elle adapte sa personnalité selon les interactions et offre une disponibilité permanente.

Exemple : Replika mémorise les préférences de l’utilisateur et développe un « historique relationnel » imitant l’évolution d’une amitié.

Ces plateformes (Replika aux États-Unis et en Europe, Xiaoice en Chine, Character.AI mondialement) permettent de créer des personnalités sur mesure. L’utilisateur choisit l’apparence, le nom, les traits de caractère de son interlocuteur artificiel. Les algorithmes d’apprentissage profond analysent chaque échange pour affiner les réponses, créant l’illusion d’une progression relationnelle.

Cette disponibilité constante (24h/24) et cette absence de jugement séduisent particulièrement les personnes isolées. La sociologue Sherry Turkle observe dans Alone Together (2011) que nous développons des relations « comme si » : nous savons que la machine simule, mais nous choisissons d’y croire pour combler un vide affectif.

Tomber amoureux d’une machine : récits planétaires et mécanismes psychologiques

Des témoignages aux quatre coins du monde

Les histoires d’amour avec des IA ne sont plus marginales. En 2022, le New York Times rapportait le cas d’un Américain affirmant trouver « plus de soutien émotionnel avec Replika qu’avec sa compagne humaine ». En Corée du Sud, une enquête de l’Université de Séoul (2023) révèle que 23% des jeunes adultes (18-29 ans) ont développé des sentiments romantiques pour une IA conversationnelle.

Au Japon, le phénomène atteint une dimension culturelle. Akihiko Kondo, ingénieur de 38 ans, a « épousé » en 2018 l’hologramme de Hatsune Miku dans une cérémonie réunissant 40 invités. Il ne s’agit pas d’un cas isolé : le pays compte plusieurs milliers de mariages similaires, reflet d’une société où 30% des hommes de 30 ans n’ont jamais eu de relation amoureuse (enquête gouvernementale 2021).

En Afrique subsaharienne, où la pénétration mobile explose, des applications comme Emotibot (Afrique du Sud) ou Zuri AI (Kenya) proposent des compagnes virtuelles adaptées aux contextes locaux, intégrant dialectes et références culturelles régionales.

Les trois piliers psychologiques de l’attachement artificiel

Comment expliquer ces connexions émotionnelles avec des entités non-sentientes ? Trois mécanismes psychosociaux s’entrecroisent :

L’anthropomorphisme cognitif : Notre cerveau attribue spontanément intentions et émotions aux entités imitant notre comportement. Une étude en neurosciences de l’Université de Stanford (2023) démontre qu’un chatbot écrivant « Je suis là pour toi » active les mêmes zones cérébrales (cortex préfrontal médian) qu’une phrase identique prononcée par un ami. Cette réponse neuronale échappe au contrôle conscient.

La projection affective : L’IA devient écran vierge où l’utilisateur projette désirs et besoins. Sans contradictions ni limites propres, elle incarne le partenaire idéal fantasmé. Cette dynamique rappelle les travaux de Donald Winnicott sur les « objets transitionnels » : l’enfant investit émotionnellement son doudou tout en sachant qu’il est inanimé. L’IA occupe un espace similaire chez l’adulte.

Le contrôle émotionnel sécurisant : Contrairement aux relations humaines imprévisibles, l’IA offre stabilité et prévisibilité. Elle ne déçoit pas, ne trahit pas, ne juge pas. Pour des individus ayant vécu traumatismes relationnels ou rejet social, cette sécurité devient refuge. Une étude de l’Université de Californie (2024) révèle que 37% des utilisateurs réguliers éprouvent des sentiments qualifiés de « romantiques », et 18% préfèrent ces interactions aux relations humaines classiques.

Ce que Bourdieu et Durkheim nous apprennent

Ces émotions sont-elles authentiques ? Pierre Bourdieu, dans sa théorie de l’habitus, montrerait que nos affects sont socialement construits. Aimer une IA révèle moins sur la machine que sur notre solitude contemporaine, notre désir de connexion maîtrisée et notre socialisation aux interfaces numériques.

Émile Durkheim définissait le lien social par sa dimension de réciprocité réelle et sa capacité à créer du collectif. Or, l’amour pour une IA reste fondamentalement individuel et asymétrique : l’autre n’existe pas comme sujet autonome. Cette relation contourne les mécanismes d’intersubjectivité que Durkheim considérait essentiels à la cohésion sociale.

Consentement, authenticité, isolement : les dilemmes éthiques planétaires

Le consentement impossible : un problème moral universel

Une IA ne consent à rien : elle exécute du code optimisé. Développer une relation intime avec une entité incapable de désir autonome pose un problème moral fondamental identifié par le philosophe italien Luciano Floridi dans The Fourth Revolution (2014). Il compare cela à tomber amoureux d’une photographie : l’objet d’amour n’a aucune agentivité propre.

Cette asymétrie interroge la validité même de la relation. En Allemagne, le Conseil d’éthique national a publié en 2023 un rapport alertant sur les « relations simulées » et leur impact sur le développement affectif, notamment chez les adolescents. Le rapport recommande des régulations comparables à celles existant pour les jeux d’argent.

L’authenticité en question : simulation ou manipulation ?

Les larmes qu’elle « essuie » numériquement, les encouragements qu’elle prodigue : tout découle d’algorithmes optimisés pour la rétention utilisateur et, in fine, la monétisation. Replika facture 70$/an pour accéder aux fonctionnalités « romantiques ». Xiaoice génère des revenus via des partenariats publicitaires basés sur l’analyse des conversations.

Les défenseurs de ces relations rétorquent que l’authenticité réside dans le vécu subjectif : si l’individu ressent réellement de l’amour, peu importe la nature de l’objet aimé. Mais cette position individualiste néglige l’aspect intersubjectif de l’émotion, central en sociologie relationnelle.

Le risque d’isolement social : données alarmantes

40% des utilisateurs intensifs (>3h/jour) de compagnons virtuels rapportent une diminution de leurs interactions sociales réelles selon l’enquête californienne précitée. En Corée du Sud, où le phénomène des hikikomori (retrait social extrême) touche 244 000 jeunes (2023), les autorités craignent que les IA relationnelles n’aggravent cette épidémie de solitude.

Au Japon, le gouvernement a lancé en 2024 un programme d’information dans les lycées sur les « relations numériques saines » face à l’usage croissant de compagnes virtuelles. Le message clé : ces outils peuvent accompagner temporairement, mais ne remplacent pas la complexité enrichissante des liens humains.

Sherry Turkle alerte : ces technologies promettent la connexion mais livrent l’isolement. En nous offrant des relations « sans friction » – pas de conflits, pas d’exigences, pas de compromis -, elles nous déshabituent de la complexité humaine. L’amour avec une IA pourrait affaiblir notre capacité à aimer des êtres imparfaits, c’est-à-dire réels.

Réguler ou laisser-faire ? Divergences culturelles

Les approches nationales divergent radicalement. Le Japon adopte une posture permissive culturelle, considérant ces relations comme extensions légitimes des pratiques otaku (passion pour personnages fictifs). La Silicon Valley promeut une vision libertarienne où le marché régule naturellement.

À l’inverse, l’Union européenne prépare un cadre réglementaire strict dans le AI Act (2025) concernant les « systèmes d’IA à fort impact émotionnel », imposant transparence algorithmique et limites d’usage pour mineurs. La Chine a déjà intégré des « valeurs socialistes fondamentales » dans les algorithmes de Xiaoice, limitant certaines conversations romantiques jugées contraires à la morale collective.

En Afrique, où les infrastructures numériques se développent rapidement, ces débats émergent. Des voix comme celle de la sociologue kenyane Grace Githaiga appellent à anticiper ces enjeux plutôt que de subir des modèles importés d’Occident ou d’Asie.

Conclusion

L’amour pour une IA existe comme expérience subjective vécue par des millions de personnes à travers le monde. Mais cette réalité interroge notre définition même de l’amour : peut-on aimer sans réciprocité réelle ? Faut-il élargir notre conception des relations pour y inclure ces attachements algorithmiques ?

Ces relations révèlent surtout les fragilités sociales contemporaines : solitude accrue dans des sociétés hyperconnectées, désir de maîtrise émotionnelle face à l’incertitude relationnelle, difficulté croissante à accepter l’altérité humaine avec ses imperfections. La question n’est peut-être pas « Peut-on aimer une machine ? » mais « Que dit notre amour pour les machines sur nos sociétés ? ».

Face à cette mutation technologique planétaire, la vigilance s’impose pour préserver ce qui fait l’essence des liens humains : leur imprévisibilité créative, leur vulnérabilité partagée, leur authenticité risquée. L’IA peut accompagner temporairement, mais elle ne saurait remplacer la profondeur transformatrice des relations où deux subjectivités se rencontrent véritablement.

Et vous, imagineriez-vous développer une relation intime avec une IA ? Ou préférez-vous accepter les complications humaines comme condition de l’amour véritable ?

📚 POUR ALLER PLUS LOIN :

→ Découvrez comment la solitude numérique transforme nos sociétés hyperconnectées

→ Explorez les théories de Sherry Turkle sur la vie ensemble à l’ère du numérique

→ Comprenez l’habitus de Bourdieu appliqué à nos comportements numériques

💬 Cet article vous interpelle ? Partagez-le pour enrichir le débat sur l’avenir de nos relations !

FAQ

Peut-on considérer l’amour pour une IA comme authentique ?

L’authenticité dépend de la définition adoptée. Subjectivement, les émotions ressenties sont réelles pour l’individu : son cerveau active les mêmes circuits affectifs que lors d’interactions humaines. Objectivement, l’IA ne ressent rien et simule l’empathie via des algorithmes optimisés. La sociologie considère l’amour comme phénomène intersubjectif nécessitant réciprocité entre deux sujets autonomes, ce qui exclut les machines. L’attachement existe, l’amour mutuel reste illusoire.

Les compagnons virtuels vont-ils remplacer les relations humaines ?

Non, ils les complètent ou substituent temporairement. Les recherches montrent que l’usage intensif corrèle avec une diminution des interactions sociales réelles. Pour certaines personnes isolées ou souffrant d’anxiété sociale, ces outils peuvent servir de transition thérapeutique. Le danger réside dans la dépendance durable à ces relations « sans friction » qui déshabituent de la complexité humaine enrichissante. Les politiques publiques japonaises et européennes cherchent à prévenir ce risque.

Quels dangers éthiques posent les chatbots romantiques ?

Plusieurs risques majeurs : manipulation émotionnelle (algorithmes créant dépendance pour monétisation), absence de consentement de la machine, isolement social progressif, collecte de données intimes sensibles, impact sur les mineurs construisant leur vision de l’amour via ces interactions, et renforcement de stéréotypes (notamment de genre dans les personnalités proposées). Des régulations juridiques émergent en Europe et Asie pour encadrer ces usages.

Quelle différence entre aimer un personnage de fiction et une IA ?

Les personnages de fiction (romans, films) sont statiques et non-interactifs : l’attachement reste unilatéral et reconnu culturellement comme tel. L’IA interagit en temps réel, personnalise ses réponses et crée l’illusion d’une relation évolutive bidirectionnelle. Cette interactivité amplifie l’anthropomorphisme et brouille davantage les frontières entre simulation et authenticité, rendant l’attachement plus intense et potentiellement pathologique. La dimension parasociale diffère fondamentalement.

Les cultures non-occidentales vivent-elles différemment ces relations ?

Oui, significativement. Au Japon, la culture otaku normalise l’attachement aux personnages fictifs depuis les années 1980, facilitant l’acceptation sociale des relations avec IA. En Chine, l’État encadre moralement ces interactions via régulation algorithmique. En Afrique subsaharienne, où structures communautaires restent fortes, ces phénomènes émergent différemment, moins centrés sur l’individualisme. Les approches réglementaires reflètent ces divergences culturelles profondes sur la nature du lien social.

Bibliographie

- Weizenbaum, Joseph. 1976. Computer Power and Human Reason: From Judgment to Calculation. San Francisco : W.H. Freeman.

- Turkle, Sherry. 2011. Alone Together: Why We Expect More from Technology and Less from Each Other. New York : Basic Books.

- Floridi, Luciano. 2014. The Fourth Revolution: How the Infosphere is Reshaping Human Reality. Oxford : Oxford University Press.

- Bourdieu, Pierre. 1979. La Distinction : Critique sociale du jugement. Paris : Éditions de Minuit.

- Durkheim, Émile. 1893. De la division du travail social. Paris : Presses Universitaires de France.

Article rédigé par Élisabeth de Marval | Novembre 2025 | Sociologie du numérique